Этот проект посвящен тому, как генеративная модель может перенести исторический визуальный стиль в современные сцены. Для обучения я собрала датасет из 21 public domain-изображения японской гравюры XIX века, выбранных из Public Domain Image Archive, и дообучила Stable Diffusion XL с помощью LoRA. В итоговой серии я проверяю, насколько убедительно модель переносит признаки укиё-э в образы современного города.

Идея проекта

Мне было важно исследовать не отдельного персонажа, а визуальный язык. Я выбрала японскую гравюру как очень узнаваемую систему изображения пространства: плоскостную композицию, крупные цветовые пятна, ритм линий, внимание к погоде, архитектуре и природным формам. После обучения модели на таком материале я попробовала сгенерировать не исторические копии, а новые сцены, связанные с городом, дорогой, мостами, водой, погодой и временем суток. Попробовать создать какой-то свой маленький и никому не известный японский городок.

Проект строится на встрече двух разных эпох. Исходный визуальный язык принадлежит XIX веку, а итоговые генерации отсылают к современному восприятию городской среды. За счет этого серия работает как перенос одного образного строя в другой контекст.

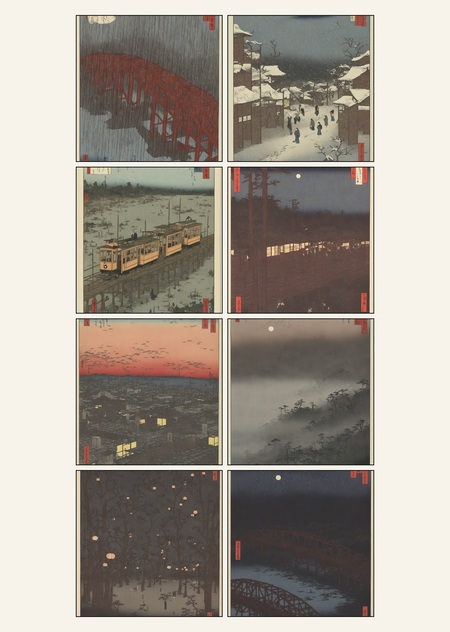

Исходный датасет

Для обучения был собран датасет из 21 public domain-изображения японской гравюры Утагавы Хиросиге из архива Public Domain Image Archive. При отборе я ориентировалась на работы одного узкого стилистического круга, связанного с японским пейзажем и городской средой, чтобы модель лучше уловила общие признаки изображения. Дополнительно я проверяла правовые пометки на страницах изображений и фиксировала источники.

При отборе датасета меня интересовали следующие признаки:

— плоскостная композиция; — выразительный контур; — крупные цветовые зоны; — внимание к погоде и атмосфере; — соединение архитектуры, природы и движения.

Ниже несколько примеров оригинальных изображений:

Процесс обучения

Для обучения использовался учебный Colab-ноутбук из курса, адаптированный под мой датасет. В качестве метода я использовала LoRA-дообучение Stable Diffusion XL. Такой подход позволил мне работать даже с небольшим набором изображений и затем получать новые сцены по текстовым запросам.

Сначала я собрала и очистила датасет, затем привела изображения к единому квадратному формату и загрузила их в среду обучения. После этого был создан файл metadata.jsonl с автоматическими подписями и добавленным стилевым префиксом in the style of hirostyle. Затем была запущена модель, а после обучения выполнены несколько тестовых генераций с разными prompt-формулировками. Из них я отобрала те результаты, в которых признаки исторического стиля считывались наиболее убедительно.

Итоговая серия

1. Дождливый мост

2. Зимняя улица 3. Трамвай у воды

4. Крыши на закате

5. Вечерняя станция. 6. Туманная набережная

7. Ночной парк фонариков. 8. Река и мост ночью

Комментарий к результатам

В итоговой серии модель достаточно хорошо перенесла основные характеристики выбранного визуального языка. Лучше всего сохранились плоскостность пространства, ритм линий, крупные цветовые массы и особое внимание к погоде, небу, воде и городскому силуэту. Благодаря этому изображения выглядят не как нейтральные цифровые иллюстрации, а как сцены, построенные по логике японской гравюры.

При этом итоговые кадры не являются прямым повторением исторических работ. Я сознательно использовала современные или обобщенные мотивы: городской мост, вечернюю улицу, набережную, станцию, зимний пейзаж, туман, электрический свет. Это позволяет увидеть, как модель переносит не конкретную картинку, а систему визуальных отношений.

Наиболее интересным результатом для меня стало то, что исторический стиль оказался способен работать с современным городским сюжетом. Серия не просто воспроизводит эстетику прошлого, а показывает, как старый образный язык может быть продолжен и в новых сценах.

Изображения отличаются друг от друга по времени суток, погоде, масштабу и плотности городской среды. В одних кадрах акцент сделан на мостах и воде, в других — на крыше, улице, станции или парковой среде. За счет этого серия выглядит цельной, но не монотонной: каждое изображение развивает общий стиль по-своему.

Не все генерации были одинаково точными. В некоторых тестовых изображениях стиль передавался слабее, а иногда появлялись случайные цифровые детали, выбивающиеся из общей логики. Это связано с особенностями генеративной модели и ограниченным объемом датасета. Тем не менее, финально отобранная серия показывает, что задача проекта была выполнена: модель научилась переносить признаки исторического стиля в новые изображения.

Описание применения генеративной модели

В проекте использовалась генеративная модель Stable Diffusion XL, дообученная на public domain-датасете изображений японской гравюры. Для обучения применялся учебный Colab-ноутбук из курса, адаптированный под выбранный набор изображений. Дополнительно генеративный ИИ (ChatGPT.com) использовался как вспомогательный инструмент для структурирования описания проекта, чистке кода и ошибок, подготовки части prompt-формулировок и черновой редакции текста.

Техническая справка

— Базовая модель: Stable Diffusion XL Base 1.0 — Метод: LoRA — Размер датасета: 21 изображение — Формат изображений: 1:1 — Источник датасета: Public Domain Image Archive — Среда запуска: Google Colab